La modération des contenus illicites sur les plateformes numériques est devenue un enjeu crucial dans le cadre de la sécurité en ligne. Avec la montée en puissance des réseaux sociaux et de l’IA générative, la nécessité de mettre en place un système de signalement performant est plus pressante que jamais. Le respect des règles de modération et la protection des utilisateurs sont désormais au cœur des préoccupations sociétales. Pour agir contre la haine en ligne et promouvoir un internet sain, des initiatives sont mises en œuvre pour instaurer des systèmes adaptés et efficaces.

Les défis que représente ce processus sont nombreux. Les plateformes doivent naviguer entre la liberté d’expression et la nécessité de contrôler les contenus pour protéger les utilisateurs. L’émergence de nouvelles technologies, comme les algorithmes de modération, alimente le débat sur la responsabilité des entreprises dans la lutte contre les contenus nuisibles. Les témoignages d’experts et de responsables sur cette problématique mettent en lumière les efforts déployés pour remédier à cette situation. Les statistiques et les exemples de bonnes pratiques permettront de mieux comprendre les enjeux et d’identifier les solutions critiques à développer dans la lutte contre les contenus illicites.

Dynamique actuelle de la modération des contenus en ligne

La modération des contenus illicites s’articule autour de la nécessité d’un système performant de signalement, essentiel pour garantir la sécurité en ligne. Les réseaux sociaux, comme Facebook, Twitter et Instagram, ont mis en place des mécanismes pour permettre aux utilisateurs de signaler des contenus problématiques. Ces systèmes visent à détecter et à prévenir les publications qui enfreignent les règles de respect de la communauté.

Importance du signalement dans la lutte contre les contenus illicites

La centralisation des signalements offre aux plateformes une vue d’ensemble des problématiques rencontrées. Par exemple, les statistiques de l’association Point de Contact révèlent qu’elle a traité plus de 120 000 signalements en 2025. Ces chiffres illustrent l’ampleur du défi que représente la gestion de ces remarques, souvent sensibles et urgentes. L’association transmet les signalements jugés illicites aux plateformes partenaires, comme PHAROS, qui prennent en charge le retrait de ces contenus. Ce processus doit être rapide et efficace pour protéger les utilisateurs et respecter les règles en vigueur.

En parallèle, les plateformes doivent s’assurer de contrôler les contenus de manière régulière. L’installation d’algorithmes capables d’évaluer les publications est une étape cruciale pour anticiper les risques. Par exemple, Google a développé une Content Safety API qui permet d’analyser automatiquement les images et vidéos signalées, fournissant ainsi aux équipes de modération une note de probabilité pour chaque contenu. Cette approche aide à établir des priorités dans le traitement des signalements.

Les défis d’une modération efficace

De nombreux obstacles se dressent sur le chemin d’une modération efficace. La vitesse d’apparition de nouveaux contenus générés par l’IA – tels que des deepfakes ou des images synthétiques – complique le travail des modérateurs. Faute de technologies de détection fiables, les équipes doivent doubler leurs efforts pour former leurs membres et développer une connaissance approfondie des dynamiques en jeu. L’absence de solutions automatisées adaptées rend ce travail encore plus complexe, prolongeant les délais de prise de mesures appropriées.

Tendances et technologies dans la modération de contenus

Les innovations technologiques ont révolutionné la modération des contenus illicites, plusieurs stratégies émergent dans ce domaine. L’introduction de l’intelligence artificielle et des algorithmes avancés permet aux plateformes de mieux gérer les signalements. Grâce à ces outils, il est aujourd’hui possible de développer des systèmes de modération basés sur le machine learning pour identifier et filtrer des contenus en temps réel.

La place de l’IA dans le processus de modération

Les plateformes de contenu utilisent des solutions d’IA pour analyser les comportements des utilisateurs et détecter les tendances. Par exemple, des entreprises telles que Meta et TikTok investissent massivement dans des technologies capables de modéliser le langage et d’identifier des propos de haine ou d’incitation à la violence. En parallèle, des entreprises comme OpenAI développent des technologies de traitement de langage naturel pour détecter des contenus nuisibles plus efficacement.

Malgré ces avancées, il existe des préoccupations concernant la transparence des algorithmes et la préservation des droits fondamentaux. Des études ont montré que l’IA peut parfois aboutir à des décisions biaisées sur les contenus, affectant ainsi la liberté d’expression. Les tensions entre les acteurs de la tech et les régulateurs continuaient d’alimenter les débats autour de la responsabilité et de la transparence. La réglementation, comme le Digital Services Act, incite les entreprises à construire des systèmes de modération conformes aux droits des utilisateurs tout en respectant les principes de sécurité.

Une meilleure sensibilisation pour une modération des contenus optimale

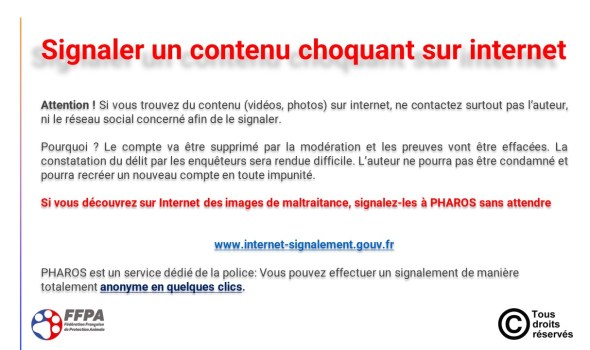

La sensibilisation des utilisateurs sur les règles de modération est cruciale pour garantir un système de signalement performant. En informant les utilisateurs sur ce qui constitue un contenu illicite, les plateformes peuvent s’assurer que les signalements seront pertinents et en adéquation avec les enjeux sociétaux. Par ailleurs, fournir des ressources éducatives sur la sécurité en ligne aide à renforcer la confiance des utilisateurs envers les systèmes de modération.

Des initiatives, comme des campagnes de sensibilisation sur les réseaux sociaux, peuvent contribuer à faire évoluer la perception du signalement. Les utilisateurs doivent comprendre qu’ils ont un rôle à jouer dans la lutte contre la haine et les comportements inappropriés en ligne. En créant un environnement collaboratif, les plateformes peuvent bénéficier d’une communauté engagée, prête à signaler les contenus illicites et à soutenir la modération.

Exemples de bonnes pratiques de modération

Les meilleures pratiques en matière de modération des contenus illicites sont cruciales pour instaurer une culture de responsabilité dans la communauté numérique. Des exemples tirés des expériences de nombreuses plateformes soulignent l’importance d’un système de signalement efficace pour garantir la sécurité des utilisateurs. Ces initiatives se sont révélées efficaces et peuvent être modélisées par d’autres acteurs.

Implémentations réussies et résultats tangibles

Des plateformes comme Twitch et Reddit se sont illustrées par leur engagement à développer des procédures de modération claires, faciles à utiliser et accessibles à leurs utilisateurs. L’adoption de mécanismes tels que des bouttons « signaler » visibles et des instructions claires incite les utilisateurs à contribuer à la création d’un environnement en ligne plus sûr. En enrichissant les services avec des outils de filtrage et de signalement, ces plateformes montrent que l’approche proactive est essentielle.

Travailler en coopération avec des organisations externes, telles que Point de Contact, permet également d’améliorer les processus internes de modération. En recevant des conseils d’experts en matière de sécurité en ligne, les plateformes peuvent adresser des problèmes spécifiques et identifier des points de blocage qui entravent l’efficacité de la modération. Des partenariats avec des entités comme NCMEC pour l’exploitation sexuelle de mineurs illustrent cette collaboration élargie.

Le rôle des utilisateurs dans l’amélioration des systèmes de modération

Les utilisateurs jouent un rôle vital dans l’amélioration des systèmes de modération en ligne. Leur engagement actif et leur volonté de signaler les contenus illicites rendent les plateformes plus réceptives aux besoins de la communauté. Encourager des comportements responsables en ligne peut également améliorer la perception générale des systèmes de modération et renforcer la confiance des utilisateurs envers les services.

Il est crucial de créer un retour d’information entre les utilisateurs et les modérateurs. La mise en place de dialogues ouverts et transparents contribue à établir une culture de responsabilité partagée qui renforce la lutte contre la haine en ligne. En collaborant étroitement avec leurs communautés, les plateformes peuvent innover et améliorer constamment leurs systèmes de signalement.

Alors que la modération des contenus illicites est un sujet en constante évolution, il est nécessaire de rester vigilant face aux défis futurs et d’adopter des stratégies innovantes. La combinaison d’initiatives de sensibilisation, de technologies de pointe et d’un soutien communautaire solide peut mener à des solutions durables et responsables pour un environnement numérique plus sûr.

| Statistiques de signalement en 2024-2025 | Nombre de signalements | Délais moyens de retrait |

|---|---|---|

| Signalements totaux en 2024 | 42 000 | Varie selon les cas |

| Signalements totaux en 2025 | 120 000 | Jusqu’à 24 heures |