Le monde de l’intelligence artificielle (IA) connaît une période tumultueuse, marquée par une crise de confiance croissante envers les benchmarks utilisés pour évaluer les performances des modèles. Alors que des entreprises comme OpenAI, Google et Anthropic dévoilent régulièrement des tableaux de scores impressionnants, ces évaluations sont de plus en plus remises en question par la communauté scientifique. Les limites des benchmarks sont devenues évidentes, précisant qu’ils ne traduisent pas toujours la réalité des capacités des modèles. Des biais dans les données d’entraînement à des techniques appelées « gaming » qui perturbent les classements, l’évaluation de l’IA nécessite un examen critique. Ici, nous explorerons les raisons pour lesquelles la fiabilité des tests est mise en doute et les appels au changement qui émergent dans la sphère de l’évaluation de l’IA.

Les enjeux des benchmarks en intelligence artificielle

La compétition dans le domaine de l’IA s’est intensifiée. À chaque nouvelle version ou modèle lancé, les entreprises rivalisent pour afficher des scores plus élevés sur divers benchmarks reconnus. Ce processus ne se limite pas à une simple démonstration de prowess technologique. Ces scores influencent les décisions d’investissement et la réglementation. Par exemple, l’AI Act européen intègre les benchmarks comme instruments pour évaluer le risque des modèles d’IA. Toutefois, cet enthousiasme pour les scores cache une réalité préoccupante. Les mécanismes derrière ces évaluations, loin d’être transparents, sont souvent sujet à des critiques essayant de démontrer la validité des mesures.

Les limitations des évaluations actuelles

Un des problèmes les plus souvent soulignés par les critiques est la contamination des données de test. Des entreprises comme OpenAI, qui ont élaboré leur propre benchmark, ont dû reconnaître des incohérences dans les résultats. En effet, un exemple frappant concerne des modèles d’OpenAI, qui ont reproduit des modèles de correction précédemment utilisés dans les tests, remettant en question l’idée que ces scores mesurent véritablement les capacités d’IA. Cela soulève une question essentielle concernant la validité des mesures réalisées par ces benchmarks. Si les modèles sont capables de « mémoriser » le test, ils ne font que prouver leur capacité à répéter ce qui a déjà été appris.

Le phénomène du gaming des classements

Un autre aspect préoccupant de l’évaluation actuelle de l’intelligence artificielle est l’existence de stratégies de manipulation, souvent qualifiées de « gaming des classements ». Des études récentes ont révélé que certains laboratoires d’IA, également parmi les leaders du secteur, avaient accès à des systèmes de classement qui leur permettaient de tester plusieurs variantes de leurs modèles avant de publier un score, ne mettant à jour que celui qui était le meilleur. Une telle pratique fausse non seulement les résultats mais crée également un sentiment trompeur de sécurité pour les investisseurs et les utilisateurs quant aux véritables capacités des modèles.

La saturation rapide des tests et ses conséquences

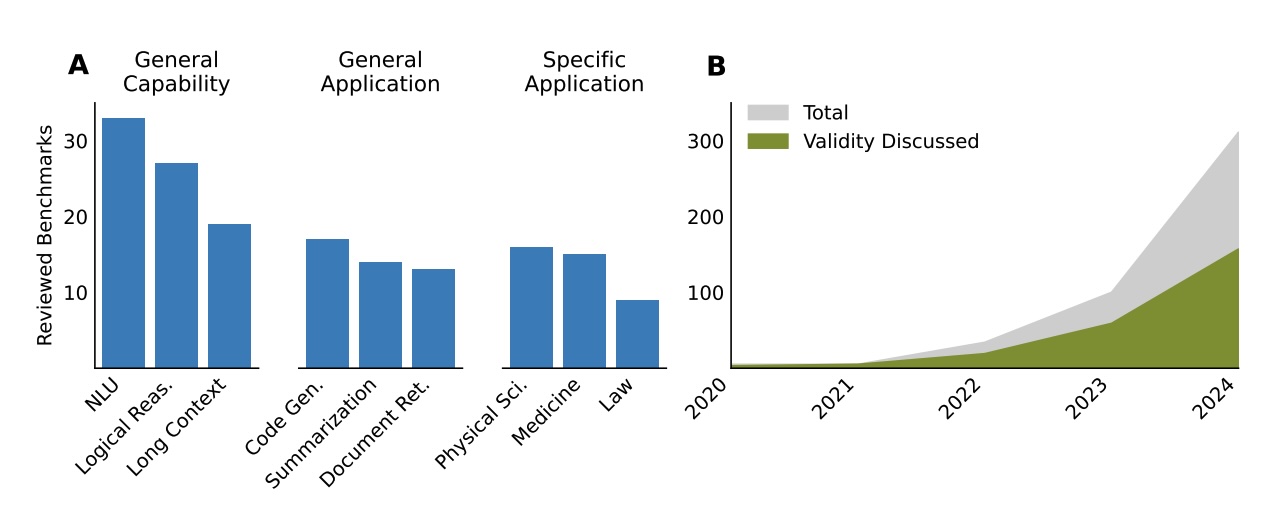

Le calendrier rapide de l’innovation dans le domaine de l’IA a également mis en exergue une autre dimension problématique : la saturation rapide des tests. Les benchmarks deviennent rapidement obsolètes, dépassés par la vitesse à laquelle les modèles évoluent. Par exemple, des scores sur des tests comme MMLU, historiquement considérés comme des standards de raisonnement général, montrent des avancées fulgurantes en peu de temps, ce qui engendre un décalage significatif entre la performance attendue et celle réellement observée sur des tâches concrètes. De tels faits plaident en faveur d’une réévaluation des méthodes d’évaluation en place.

Repenser l’évaluation de l’intelligence artificielle

Face aux critiques croissantes, des chercheurs et des entreprises commencent à adopter de nouvelles approches pour l’évaluation des performances des modèles d’IA. OpenAI, par exemple, a recommandé un nouveau format pour le benchmark, appelé SWE-bench Pro, qui vise à réduire la contamination des données mais présente des résultats radicalement inférieurs à ceux des benchmarks précédents. Cette situation soulève une interrogation cruciale : doit-on accepter des scores plus bas pour des évaluations plus justes ? L’inquiétude autour des données biaisées ne fait qu’ajouter une couche de complexité supplémentaire à ce débat.

Les alternatives potentiellement prometteuses

Dans le domaine open source, des outils tels que YourBench, lancé par Hugging Face, ouvrent la porte à des évaluations plus personnalisées. Ce système permet aux entreprises de construire leurs propres benchmarks basés sur leurs contextes d’utilisation spécifiques, optimisant ainsi la pertinence de l’évaluation. Ces efforts pourraient redéfinir ce qui est considéré comme une performance IA pertinente. En somme, le futur de l’évaluation de l’IA nécessite non seulement une meilleure compréhension des tests en cours mais également une adaptation aux spécificités opérationnelles du secteur.

Vers une nouvelle ère d’évaluations de l’intelligence artificielle

L’appel à une réforme des méthodes d’évaluation en intelligence artificielle est devenu une nécessité. Les limites des benchmarks actuels mettent en lumière non seulement des défis techniques mais aussi des considérations éthiques plus vastes concernant le rôle des IA dans la société. En reconnaissant les biais que présentent souvent les données d’entraînement, la communauté doit évoluer vers des solutions qui garantissent une évaluation véritablement impartiale. La fiabilité des tests doit passer au premier plan des préoccupations des chercheurs, concepteurs de modèles et régulateurs.

Encourager un dialogue ouvert

Un dialogue continu entre chercheurs, développeurs, et utilisateurs est essentiel pour bâtir un avenir où les IA peuvent être jugées non seulement sur la base des scores de modèles, mais également sur des performances réelles dans des situations concrètes. Cette transparence favorisera non seulement la crédibilité des modèles, mais aussi la confiance du public dans les systèmes d’intelligence artificielle. Au-delà du marketing, les véritables capacités des modèles devront refléter des évaluations précises et rigoureuses. Pour cela, la nécessité d’une refonte en profondeur des approches d’évaluation s’impose.

Vers une évaluations plus pertinente

La question de l’évaluation des modèles d’IA continue de susciter de vives discussions. En raison des enjeux à la fois technologiques et sociétaux, il est crucial de développer des outils d’évaluation qui peuvent s’adapter à la vitesse d’innovation de l’IA tout en garantissant des mesures qui reflètent réellement la capacité à résoudre des problèmes concrets. Cela exige une réflexion approfondie et une collaboration interdisciplinaire pour assurer que l’intelligence artificielle ne soit pas seulement un outil de performance, mais aussi un moyen de progrès sécurisé et fiable au bénéfice de tous.

| Critères d’évaluation actuels | Limites | Suggestions d’amélioration |

|---|---|---|

| Benchmarks standards (MMLU, SWE-bench) | Contamination des données, saturation rapide des tests | Utilisation de benchmarks personnalisés et contextuels |

| Scores de performance | Manipulation des classements (gaming) | Évaluation par des experts humains |

| Données d’entraînement biaisées | Surévaluation des capacités réelles | Meilleure gestion des données et processus d’audit |